为了更快的定位您的问题,请提供以下信息,谢谢

【详述】通过外部表功能创建HIVE ORC外部表,外部表查询报错

【背景】hive orc表会定期进行分区数据更新覆盖操作

【业务影响】 HIVE外部表数据不能用

【是否存算分离】

【StarRocks版本】 3.3.6

【集群规模】例如:1fe + 5be 独立部署

【机器信息】CPU虚拟核/内存/网卡,例如:16C/32G/万兆

【联系方式】为了在解决问题过程中能及时联系到您获取一些日志信息,请补充下您的联系方式,例如:社区群1-石基-魔咒

【附件】

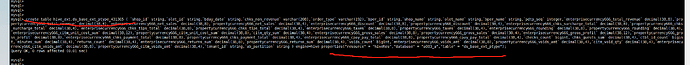

创建外部表:

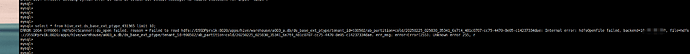

查询外部表:

报错信息: ERROR 1064 (HY000): HdfsOrcScanner::do_open failed. reason = Failed to read hdfs://D5SDPprv1k:8020/apps/hive/warehouse/a003_a.db/ds_base_ext_ptype/tenant_id=t00502/ab_partition=cold/20250225_025830_35341_6s7t4_481c0707-cc75-4470-8e05-c14237334dae: Internal error: hdfsOpenFile failed, backend=XX.XX.XX.XXX file=hdfs://D5SDPprv1k:8020/apps/hive/warehouse/a003_a.db/ds_base_ext_ptype/tenant_id=t00502/ab_partition=cold/20250225_025830_35341_6s7t4_481c0707-cc75-4470-8e05-c14237334dae. err_msg: error=Error(255): Unknown error 255, r

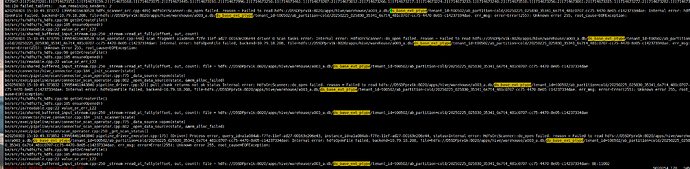

BE日志信息:

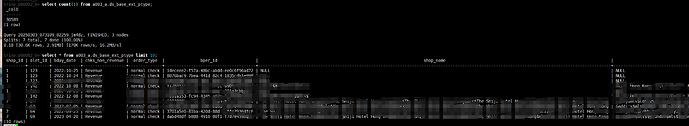

hdfs信息:

hive orc表是正常的 ,可以通过trino正常查询这个hive表

目前处理方法需要将hive的表进行重建、数据重写后。SR才通过hive外部表能正常访问。